La IA nos vuelve a engañar: la falsa colaboración entre Adidas y Barbie que ha causado furor en los últimos días.

Estas últimas semanas ha estado circulando por las redes sociales una supuesta campaña de colaboración entre Adidas y Barbie. Las imágenes que se compartieron mostraban una colección de zapatillas y ropa deportiva de edición especial, todas con los colores y el logotipo de Barbie.

La noticia causó furor entre los fans de la muñeca, que rápidamente comenzaron a compartir las imágenes y a especular sobre el precio y la disponibilidad de las prendas.

Sin embargo, poco después, Adidas se pronunció para negar cualquier colaboración con Barbie.

La compañía explicó que las imágenes que se habían compartido eran falsas, y que habían sido creadas utilizando inteligencia artificial (IA). Adidas también dijo que no tenía planes de lanzar una colección de ropa o zapatillas deportivas con Barbie en el futuro.

Este caso es un ejemplo más de cómo la IA puede ser utilizada para crear imágenes falsas que pueden ser indistinguibles de las reales. Es importante ser conscientes de este peligro y comprobar siempre la autenticidad de las imágenes que vemos en las redes sociales.

En este caso, los fans de Adidas y Barbie se llevaron una decepción al descubrir que la colaboración era falsa. Sin embargo, el caso también ha servido para concienciar sobre los peligros de la IA y la importancia de verificar la autenticidad de las imágenes que vemos en las redes sociales.

También te puede interesar: Barbie, se convierte en la película más esperada, y conquista.

¿Cómo se crean las imágenes falsas con IA?

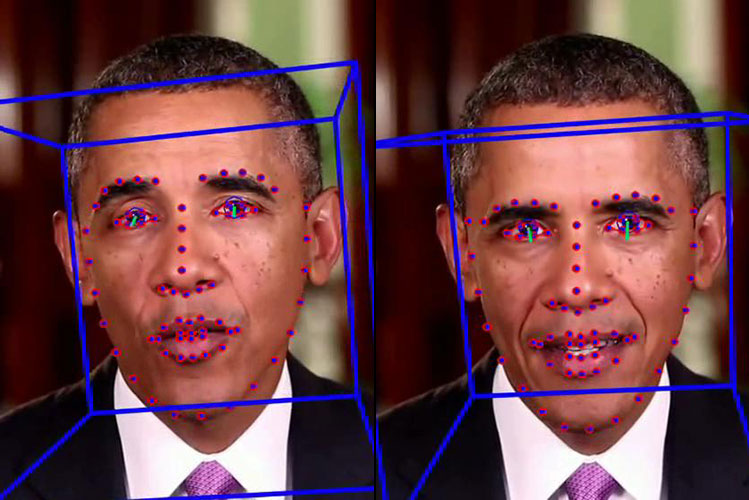

Las imágenes falsas con IA se crean utilizando un tipo de software llamado deepfake. El deepfake es una técnica de inteligencia artificial que permite crear videos o imágenes que parecen reales, pero que en realidad han sido manipulados. Para crear un deepfake, los creadores utilizan un algoritmo de aprendizaje automático para entrenar una red neuronal. Esta red neuronal se alimenta de una gran cantidad de datos, que incluyen videos, imágenes y texto. La red neuronal aprende a identificar los patrones en los datos y a generar nuevas imágenes que son similares a las que ha visto.

Una vez que la red neuronal está entrenada, se puede utilizar para crear imágenes falsas. Los creadores simplemente introducen una imagen o un video de la persona que quieren manipular. La red neuronal entonces genera una nueva imagen que muestra a la persona con los rasgos faciales alterados.

¿Cuáles son los peligros de las imágenes falsas con IA?

Pueden ser utilizadas para difundir desinformación, para manipular las opiniones públicas o incluso para cometer fraudes.

Por ejemplo, las imágenes falsas pueden ser utilizadas para crear videos de políticos diciendo cosas que nunca dijeron. Estos videos pueden ser utilizados para desprestigiar a los políticos o para influir en las elecciones.

Las imágenes falsas también pueden ser utilizadas para crear anuncios publicitarios que son engañosos. Estos anuncios pueden ser utilizados para vender productos o servicios que no son lo que parecen.

Es importante ser conscientes de los peligros de las imágenes falsas con IA. Si ves una imagen que parece demasiado buena para ser verdad, es probable que lo sea. Antes de compartir una imagen, asegúrate de verificar su autenticidad.

¿Crees que en algún momento la IA reine el mundo del marketing, o ya lo está haciendo y no nos hemos dado cuenta? Checa nuestros siguientes blogs y quizá podamos descubrirlo. ¡Contáctanos!